作者:药丸子 来源:MR茄哥

众所周知,近几年,AI换脸技术火遍国内外。

不论是素人,还是明星,都能运用这项电脑技术把自己的脸换成别人的,又或者是把别人的脸换成自己的。

就跟易容术似的。所以,不少网友都感觉十分有趣。

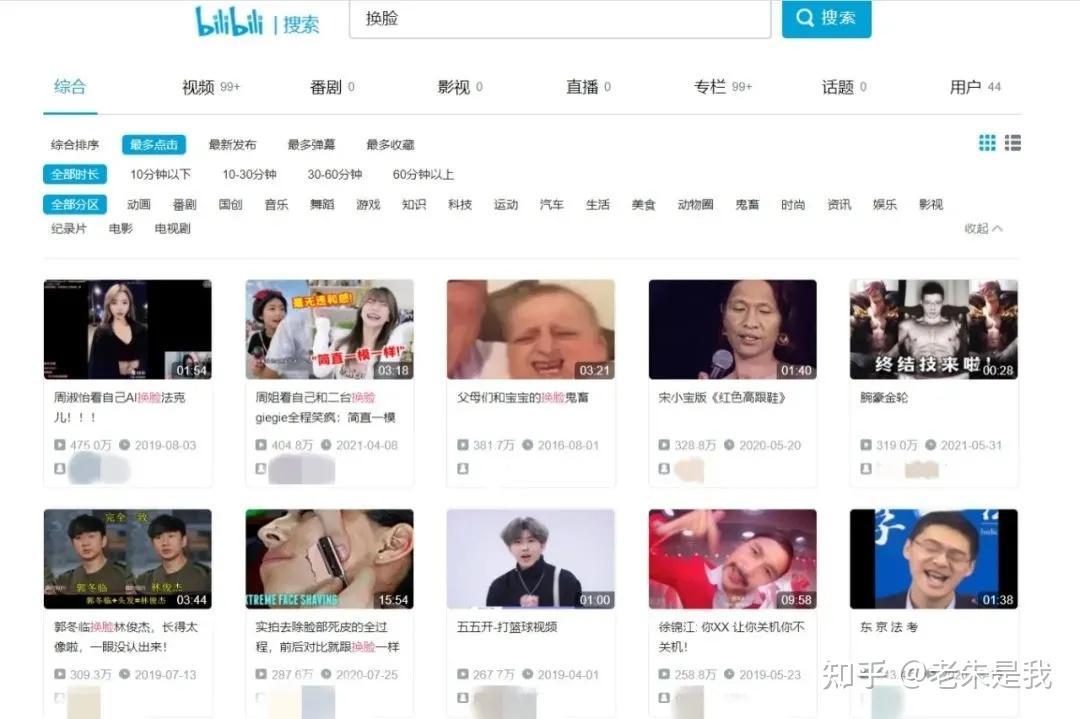

特别是当我们在网站上,看到的那些明星换脸“搞笑视频”,更是忍俊不禁。

但很多人不知道,这项技术在给人们带来欢乐和趣味的时候,却也有人因为这项技术深受其害。

前段时间,曾看过这样一则新闻:“互联网上大量出现,通过AI换脸实现的由知名女艺人主演的淫秽视频。”明星+AI换脸技术+小电影,一部明星的“造假视频”就这样诞生了。

而据了解,受害女星人数已达到上百位,其中就有杨超越、刘亦菲、杨幂、迪丽热巴等当红女星。由此可见,“AI换脸”已经不仅仅是一门技术。而是一条依附于“AI换脸”的黑色产业链。新京报记者伪装成卖家,了解到了一些关于“AI色情换脸女明星”的内部消息。通过卖家得知:“(购买)低于15部算4元一部,超过15部算3元一部,80部全买只要68元。”而视频文件将通过QQ文件发送,支持微信、支付宝、QQ红包等支付方式。

在这些人的黑暗操作下,女明星的脸被合成为了一部部“色情片”,甚至被明码标价。

前段时间B站(哔哩哔哩)和B站上的一个UP主被林俊杰告了,而且林俊杰胜诉了。

目前这位UP主需要向林俊杰赔偿27.5万元,原因是这位UP主用AI换脸技术制作了大量林俊杰的鬼畜视频。

8月28日,艺人刘昊然的工作室也发布声明称,有人利用AI换脸技术传播对刘昊然带有侮辱性的视频、截图,同时还含有诽谤言论的聊天记录。该工作室表示,今年1月就曾被恶意传播,目前已向警方报案。或许会有人说:反正都是那些知名的女星才会受害,我们这些普通人,谁会认识啊?

但大家不知道的是,在“AI换脸”技术下,每个人都可能成为受害者。“AI换脸”的应用场景不仅是色情视频,还可能被用于电信诈骗。

如果有人通过“换脸”向“被换脸者”的亲友索要钱财,就算诈骗不成功,也可以造成损害当事人名誉的影响。

为何AI换脸技术的声势如此浩大?原因在于技术成本和经济成本的门槛都不高。

不需要先进的装备,只要一个软件就可以。之前有推特用户便开发出一款名叫DeepNude的应用,只要给DeepNude一张女性照片,借助神经网络技术,App可以自动“脱掉”女性身上的衣服,显示出裸体。随后,DeepNude应用及网站因滥用被关闭。

还有今年6月份,有个程序员开发了一套AI系统,只要在APP中上传一张女生的照片,程序就可以自动将这个女生的样貌与成人网站中女生的照片进行比对,辨别出她是否曾是性工作者。有热心网友替他想好了产品的名字:“原谅宝”。

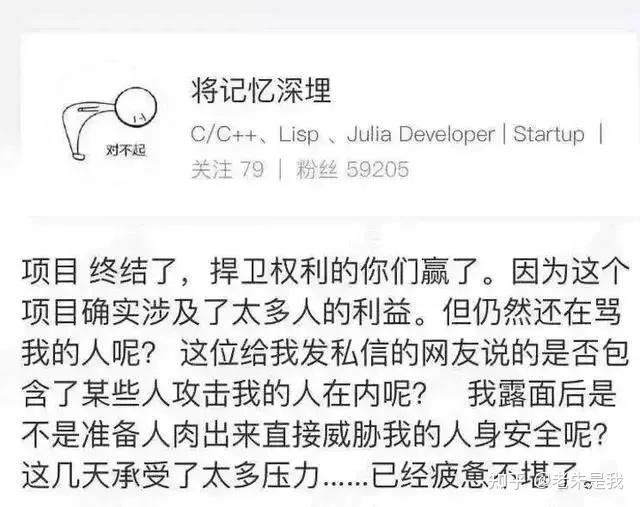

这个“@将记忆深埋” 随后表示,已经“在全球范围内成功识别了 10 多万名疑似从事色情行业的女性”.同时,可以对美颜、Deepfakes 换脸等有效对抗,识别率达到 99%,而对于声音语气模仿采用声纹检测对抗,识别率达到 100%。这个消息一经发布立马就炸了,这个系统的设计,对女性太有针对性。迫于舆论压力,作者删除了整个项目和数据库,因言论给他人造成不便而道歉告终。

在科技界,一直有句话叫“技术无罪”,都说技术只是单纯的技术,只是看掌握技术的人用技术来干什么。

有理想的人用AI改变世界,猥琐的人只想得到制作明星成人视频,可能这就是差距吧。

上一篇

上一篇